O Roblox Studio tem se tornado cada vez mais um campo de testes para assistentes de IA agentivos, projetados para ajudar criadores a desenvolver jogos mais rápido. Embora essas ferramentas já consigam escrever scripts, inserir assets e modificar ambientes, medir o quão bem elas realmente performam em cenários de desenvolvimento reais tem sido difícil. O OpenGameEval visa resolver esse problema introduzindo um framework nativo do Roblox Studio para avaliar assistentes de IA em condições realistas.

Desenvolvido por Tiantian Zhang, Kartik Ayyar, Mengsha Sun e Lynn Gong, o OpenGameEval é posicionado como o primeiro sistema de avaliação construído diretamente em torno dos fluxos de trabalho do Roblox Studio. Em vez de isolar trechos de código ou depender de prompts stateless, ele executa modelos de IA dentro de sessões simuladas de edição e play, que se assemelham muito à forma como os criadores realmente trabalham.

Por que os Benchmarks Tradicionais Falham para o Roblox

A maioria dos benchmarks de IA existentes foca em problemas de codificação restritos com entradas e saídas claramente definidas. O desenvolvimento no Roblox raramente se encaixa nesse molde. Jogos são construídos dentro de mundos 3D persistentes onde scripts interagem com hierarquias de objetos, networking multiplayer e limites de cliente-servidor. Mudanças feitas em uma parte de uma experiência frequentemente dependem de contexto espalhado por múltiplos scripts e instâncias.

O OpenGameEval foi criado em resposta a essas limitações. Seu objetivo é testar se um assistente de IA pode raciocinar através de um ambiente Roblox ativo, entender a lógica existente e fazer mudanças que se sustentem quando o jogo for realmente executado. Essa abordagem muda a avaliação de correção teórica para utilidade prática para os criadores.

Um Olhar Mais Atento ao Framework OpenGameEval

Em sua essência, o OpenGameEval recria o ambiente de desenvolvimento do Roblox Studio de forma reproduzível. Cada avaliação simula comportamento tanto em tempo de edição quanto em tempo de jogo, garantindo que a física, o networking e as interações multiplayer se comportem exatamente como fariam em um projeto real. Isso permite que os avaliadores observem como as mudanças de um assistente de IA afetam uma experiência uma vez que ela esteja rodando, não apenas se o código compila.

O framework também inclui simulação de entrada, que possibilita acionar ações do jogador como movimento, pressionamento de botões e mudanças de câmera durante os testes. Isso é particularmente importante para avaliar recursos que só revelam problemas através da interação. Toda essa funcionalidade é exposta através de uma API unificada, tornando mais fácil para as equipes de pesquisa compararem diferentes modelos de linguagem grandes no mesmo conjunto de tarefas.

Testando Cenários de Desenvolvimento Reais, Não Apenas Trechos de Código

O conjunto de dados de benchmark do OpenGameEval atualmente inclui 47 casos de teste criados manualmente. Cada um deles é baseado em tarefas comuns de desenvolvimento no Roblox, incluindo mecânicas de jogo, configuração de ambiente, animação, interfaces de usuário e som. Esses cenários são construídos e revisados por especialistas do domínio para garantir que reflitam os fluxos de trabalho reais dos criadores.

Diferente de desafios de codificação tradicionais, esses testes são de ponta a ponta. Um assistente de IA bem-sucedido deve localizar scripts relevantes, interpretar a lógica existente, decidir onde o novo código pertence e implementar mudanças que funcionem tanto no cliente quanto no servidor. A pontuação é tratada através de testes unitários executáveis e métricas padrão como pass@k, permitindo que os resultados sejam reproduzidos e comparados entre modelos.

Como o Contexto Muda a Dificuldade

Uma das características definidoras do OpenGameEval é seu foco na variação contextual. O mesmo prompt pode ser avaliado em múltiplos ambientes que diferem em estrutura e complexidade. Por exemplo, uma tarefa envolvendo um semáforo de quatro vias pode ser testada em um local vazio, uma cena suburbana populada ou uma configuração que inclua sinais de trânsito e pedestres. Cada variação força o assistente de IA a adaptar seu raciocínio com base no que já está presente na experiência.

Tarefas mais complexas, como implementar um sistema de regeneração de vida, exigem que o modelo rastreie a lógica de dano através de scripts, determine se as mudanças devem ser feitas no servidor ou no cliente, e garanta que o timing e a replicação funcionem corretamente. Esses cenários são projetados para revelar se um assistente de IA pode manter o contexto através de múltiplos passos em vez de depender de correspondência de padrões superficial.

Resultados Iniciais Destacam Limitações Atuais

Resultados iniciais do OpenGameEval sugerem uma clara divisão nas capacidades atuais da IA. Modelos tendem a ter bom desempenho em tarefas atômicas que envolvem manipulação direta de uma única instância ou propriedade. Ações como ajustar o poder de pulo de um jogador ou configurar um efeito de partícula geralmente são bem-sucedidas com alta confiabilidade.

O desempenho cai drasticamente quando tarefas exigem raciocínio contextual mais profundo. Cenários envolvendo mudanças coordenadas entre scripts, filtragem cuidadosa de objetos relevantes ou compreensão de comportamento multiplayer continuam a produzir baixas taxas de sucesso. Esses resultados sublinham o quanto ainda há para melhorar antes que os assistentes de IA possam lidar de forma confiável com tarefas complexas de desenvolvimento no Roblox por conta própria.

Sinais de Progresso Constante

Apesar desses desafios, o OpenGameEval já capturou sinais de melhoria à medida que os modelos evoluem. Em uma tarefa envolvendo uma mudança de cor no logo do Roblox, modelos iniciais falharam porque o objeto não estava explicitamente nomeado. Avaliações mais recentes mostram alguns modelos identificando com sucesso o objeto correto inspecionando suas propriedades e posição na hierarquia de instâncias, em vez de depender apenas de convenções de nomenclatura.

Esses ganhos incrementais sugerem que os assistentes de IA estão lentamente melhorando no raciocínio estrutural dentro de ambientes de jogo, mesmo que a compreensão contextual mais ampla permaneça inconsistente.

O Que o OpenGameEval Significa para Criadores e Pesquisadores

O OpenGameEval é projetado para servir tanto criadores do Roblox quanto a comunidade de pesquisa de IA em geral. Um placar público oferece visibilidade sobre como diferentes modelos performam em categorias como geração de código e uso de ferramentas. Para pesquisadores, o framework fornece uma maneira padronizada de executar avaliações reproduzíveis dentro de um ambiente de game engine real.

Olhando para o futuro, a equipe por trás do OpenGameEval planeja expandir o dataset, refinar as ferramentas de avaliação e incorporar feedback da comunidade de criadores. O objetivo de longo prazo é estabelecer um ponto de referência compartilhado para medir o progresso em IA agentiva para desenvolvimento de jogos, incluindo futuras aplicações ligadas a economias de criadores no estilo web3.

Confira os Cartões Presente do Roblox na Amazon aqui.

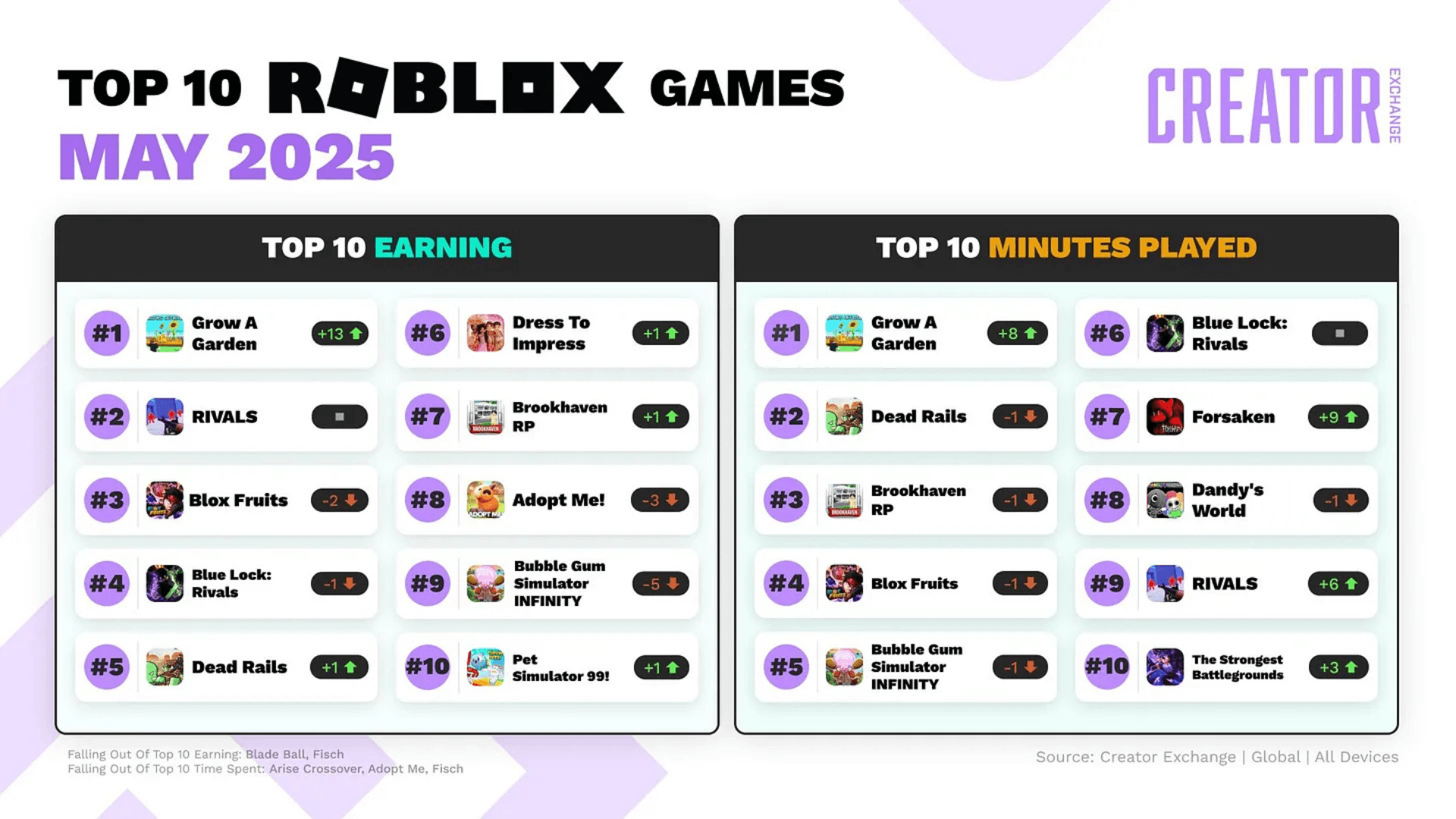

Saiba mais sobre outras experiências populares no Roblox aqui:

Perguntas Frequentes (FAQs)

O que é o OpenGameEval?

O OpenGameEval é um framework de avaliação e benchmark open-source projetado para testar assistentes de IA diretamente dentro do Roblox Studio. Ele mede o quão bem os modelos performam em tarefas de desenvolvimento reais em vez de problemas de codificação isolados.

Como o OpenGameEval se diferencia de outros benchmarks de IA?

Diferente de benchmarks tradicionais, o OpenGameEval executa avaliações em um ambiente simulado do Roblox Studio. Isso permite testar raciocínio contextual, comportamento multiplayer e interações stateful que são comuns no desenvolvimento de jogos.

Que tipos de tarefas o OpenGameEval inclui?

O benchmark inclui tarefas relacionadas a mecânicas de jogo, scripting, construção de ambiente, animação, interfaces de usuário e som. Muitas tarefas exigem raciocínio multistep através de múltiplos scripts e objetos.

Quem pode usar o OpenGameEval?

O framework é open-source e destinado a pesquisadores de IA, desenvolvedores de ferramentas e equipes que constroem ou avaliam assistentes de IA para o Roblox Studio.

Por que o OpenGameEval é importante para criadores do Roblox?

Ao fornecer dados de desempenho transparentes e avaliações realistas, o OpenGameEval ajuda os criadores a entender os pontos fortes e limitações dos assistentes de IA e a acompanhar como essas ferramentas melhoram ao longo do tempo.