Roblox Studio, geliştiricilerin oyunları daha hızlı oluşturmalarına yardımcı olmak için tasarlanmış ajan yapay zeka asistanları için giderek artan bir test alanı haline geldi. Bu araçlar zaten script yazabiliyor, varlıklar ekleyebiliyor ve ortamları değiştirebiliyor olsa da, gerçek geliştirme senaryolarında ne kadar iyi performans gösterdiklerini ölçmek zor olmuştur. OpenGameEval, gerçekçi koşullar altında yapay zeka asistanlarını değerlendirmek için Roblox Studio'ya özgü bir çerçeve sunarak bu sorunu ele almayı amaçlıyor.

Tiantian Zhang, Kartik Ayyar, Mengsha Sun ve Lynn Gong tarafından geliştirilen OpenGameEval, doğrudan Roblox Studio'nun iş akışları etrafında oluşturulan ilk değerlendirme sistemi olarak konumlanıyor. Kod parçacıklarını izole etmek veya durumsuz istemlere güvenmek yerine, geliştiricilerin gerçekte nasıl çalıştıklarına yakından benzeyen simüle edilmiş düzenleme ve oyun oturumları içinde yapay zeka modellerini çalıştırıyor.

Neden Geleneksel Kıyaslamalar Roblox İçin Yetersiz Kalıyor?

Mevcut yapay zeka kıyaslamalarının çoğu, açıkça tanımlanmış girdilere ve çıktılara sahip dar kodlama problemlerine odaklanıyor. Roblox geliştirme nadiren bu kalıba uyuyor. Oyunlar, scriptlerin nesne hiyerarşileriyle, çok oyunculu ağlarla ve istemci-sunucu sınırlarıyla etkileşimde bulunduğu kalıcı 3D dünyalar içinde inşa ediliyor. Bir deneyimin bir bölümünde yapılan değişiklikler genellikle birden fazla script ve örneğe yayılmış bağlamlara bağlıdır.

OpenGameEval, bu sınırlamalara yanıt olarak oluşturuldu. Amacı, bir yapay zeka asistanının canlı bir Roblox ortamında akıl yürütebilmesini, mevcut mantığı anlayabilmesini ve oyun gerçekten çalıştırıldığında geçerli olacak değişiklikler yapabilmesini test etmektir. Bu yaklaşım, değerlendirmeyi teorik doğruluktan geliştiriciler için pratik kullanışlılığa doğru kaydırıyor.

OpenGameEval Çerçevesine Yakın Bir Bakış

Özünde, OpenGameEval Roblox Studio geliştirme ortamını tekrarlanabilir bir şekilde yeniden yaratıyor. Her değerlendirme, fizik, ağ ve çok oyunculu etkileşimlerin gerçek bir projede olduğu gibi davranmasını sağlayarak hem düzenleme zamanı hem de oyun zamanı davranışlarını simüle ediyor. Bu, değerlendiricilerin, bir yapay zeka asistanının değişikliklerinin, kodun derlenip derlenmediğine bakılmaksızın, bir deneyimi çalışırken nasıl etkilediğini gözlemlemelerine olanak tanıyor.

Çerçeve ayrıca, testler sırasında hareket, düğme basma ve kamera değişiklikleri gibi oyuncu eylemlerini tetiklemeyi mümkün kılan girdi simülasyonunu da içeriyor. Bu, yalnızca etkileşim yoluyla sorunları ortaya çıkaran özellikleri değerlendirmek için özellikle önemlidir. Tüm bu işlevsellik, araştırma ekiplerinin aynı görev setinde farklı büyük dil modellerini karşılaştırmasını kolaylaştıran birleşik bir API aracılığıyla sunuluyor.

Sadece Kod Parçacıklarını Değil, Gerçek Geliştirme Senaryolarını Test Etmek

OpenGameEval kıyaslama veri seti şu anda 47 el yapımı test vakası içeriyor. Her biri, oyun mekanikleri, ortam kurulumu, animasyon, kullanıcı arayüzleri ve ses dahil olmak üzere yaygın Roblox geliştirme görevlerine dayanıyor. Bu senaryolar, gerçek geliştirici iş akışlarını yansıttıklarından emin olmak için alan uzmanları tarafından oluşturuluyor ve gözden geçiriliyor.

Geleneksel kodlama yarışmalarının aksine, bu testler uçtan uca gerçekleştiriliyor. Başarılı bir yapay zeka asistanı, ilgili scriptleri bulmalı, mevcut mantığı yorumlamalı, yeni kodun nereye ait olduğuna karar vermeli ve hem istemci hem de sunucuda çalışan değişiklikleri uygulamalıdır. Puanlama, yürütülebilir birim testleri ve pass@k gibi standart metrikler aracılığıyla ele alınır, bu da sonuçların modeller arasında tekrarlanabilir ve karşılaştırılabilir olmasını sağlar.

Bağlam Zorluğu Nasıl Değiştirir?

OpenGameEval'ın tanımlayıcı özelliklerinden biri, bağlamsal değişime odaklanmasıdır. Aynı istem, yapı ve karmaşıklık açısından farklılık gösteren birden fazla ortamda değerlendirilebilir. Örneğin, dört yollu bir trafik ışığını içeren bir görev, boş bir yer dosyasında, dolu bir banliyö sahnesinde veya hem trafik hem de yaya sinyallerini içeren bir kurulumda test edilebilir. Her varyasyon, yapay zeka asistanını, deneyimde zaten mevcut olana dayanarak akıl yürütmesini uyarlamaya zorlar.

Sağlık yenileme sistemi uygulamak gibi daha karmaşık görevler, modelin scriptler boyunca hasar mantığını izlemesini, değişikliklerin sunucuda mı yoksa istemcide mi yapılması gerektiğini belirlemesini ve zamanlama ile çoğaltmanın doğru çalıştığından emin olmasını gerektirir. Bu senaryolar, bir yapay zeka asistanının yüzeysel desen eşleştirmeye güvenmek yerine birden fazla adımda bağlamı koruyup koruyamayacağını ortaya çıkarmak için tasarlanmıştır.

Erken Sonuçlar Mevcut Sınırlamaları Vurguluyor

OpenGameEval'dan elde edilen ilk sonuçlar, mevcut yapay zeka yeteneklerinde net bir ayrım olduğunu gösteriyor. Modeller, tek bir örneğin veya özelliğin doğrudan manipülasyonunu içeren atomik görevlerde iyi performans gösterme eğilimindedir. Bir oyuncunun zıplama gücünü ayarlamak veya bir parçacık efektini yapılandırmak gibi eylemler genellikle yüksek güvenilirlikle başarılı olur.

Daha derin bağlamsal akıl yürütme gerektiren görevlerde performans keskin bir şekilde düşüyor. Scriptler arasında koordineli değişiklikler, ilgili nesnelerin dikkatli filtrelenmesi veya çok oyunculu davranışı anlama gibi senaryolar düşük başarı oranları üretmeye devam ediyor. Bu sonuçlar, yapay zeka asistanlarının karmaşık Roblox geliştirme görevlerini kendi başlarına güvenilir bir şekilde yerine getirebilmelerinden önce ne kadar iyileştirme alanı olduğunu vurguluyor.

Sabit İlerleme İşaretleri

Bu zorluklara rağmen, OpenGameEval modeller geliştikçe zaten iyileşme işaretleri yakaladı. Roblox logosuna renk değişikliği içeren bir görevde, nesne açıkça adlandırılmadığı için erken modeller başarısız oldu. Daha yakın tarihli değerlendirmeler, bazı modellerin adlandırma kurallarına güvenmek yerine, örnek hiyerarşisindeki özelliklerini ve konumunu inceleyerek doğru nesneyi başarıyla tanımladığını gösteriyor.

Bu artımlı kazanımlar, daha geniş bağlamsal anlayış tutarsız kalsa bile, yapay zeka asistanlarının oyun ortamlarındaki yapısal akıl yürütmede yavaş yavaş geliştiğini gösteriyor.

OpenGameEval'ın Geliştiriciler ve Araştırmacılar İçin Anlamı

OpenGameEval, hem Roblox geliştiricilerine hem de daha geniş yapay zeka araştırma topluluğuna hizmet etmek üzere tasarlanmıştır. Genel bir liderlik tablosu, farklı modellerin kod üretimi ve araç kullanımı gibi kategorilerde nasıl performans gösterdiğine dair görünürlük sunar. Araştırmacılar için çerçeve, gerçek bir oyun motoru ortamında tekrarlanabilir değerlendirmeler çalıştırmak için standartlaştırılmış bir yol sağlar.

İleriye dönük olarak, OpenGameEval'ın arkasındaki ekip veri setini genişletmeyi, değerlendirme araçlarını iyileştirmeyi ve geliştirici topluluğundan geri bildirim almayı planlıyor. Uzun vadeli hedef, oyun geliştirme için ajan yapay zekasındaki ilerlemeyi ölçmek için paylaşılan bir referans noktası oluşturmak, web3 tarzı yaratıcı ekonomilere yönelik gelecekteki uygulamalar da dahil.

Amazon'da Roblox Hediye Kartlarına buradan göz atın.

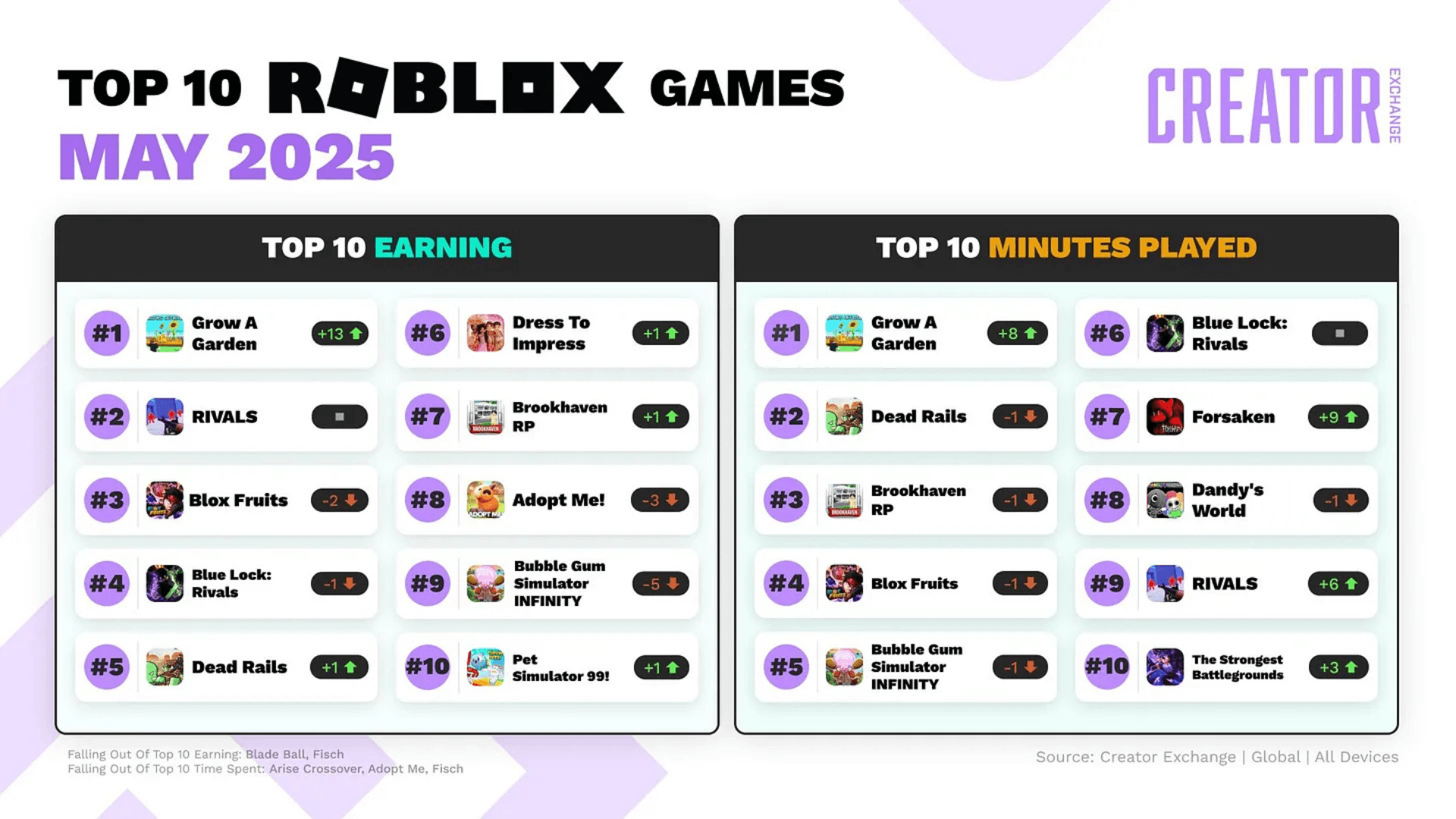

Diğer popüler Roblox deneyimleri hakkında buradan bilgi edinin:

Sıkça Sorulan Sorular (SSS)

OpenGameEval nedir?

OpenGameEval, yapay zeka asistanlarını doğrudan Roblox Studio içinde test etmek için tasarlanmış açık kaynaklı bir değerlendirme çerçevesi ve kıyaslamasıdır. Modellerin izole kodlama sorunları yerine gerçek geliştirme görevlerinde ne kadar iyi performans gösterdiğini ölçer.

OpenGameEval diğer yapay zeka kıyaslamalarından nasıl farklıdır?

Geleneksel kıyaslamaların aksine, OpenGameEval değerlendirmeleri simüle edilmiş bir Roblox Studio ortamında çalıştırır. Bu, oyun geliştirmede yaygın olan bağlamsal akıl yürütme, çok oyunculu davranış ve durumlu etkileşimleri test etmesini sağlar.

OpenGameEval ne tür görevler içeriyor?

Kıyaslama, oyun mekanikleri, script yazma, ortam oluşturma, animasyon, kullanıcı arayüzleri ve sesle ilgili görevleri içerir. Birçok görev, birden fazla script ve nesne arasında çok adımlı akıl yürütme gerektirir.

OpenGameEval'ı kimler kullanabilir?

Çerçeve açık kaynaklıdır ve yapay zeka araştırmacıları, araç geliştiricileri ve Roblox Studio için yapay zeka asistanları oluşturan veya değerlendiren ekipler için tasarlanmıştır.

OpenGameEval neden Roblox geliştiricileri için önemlidir?

Şeffaf performans verileri ve gerçekçi değerlendirmeler sağlayarak, OpenGameEval geliştiricilerin yapay zeka asistanlarının güçlü ve zayıf yönlerini anlamalarına ve bu araçların zamanla nasıl geliştiğini izlemelerine yardımcı olur.