Roblox Studio ngày càng trở thành một sân chơi thử nghiệm cho các trợ lý AI có khả năng hành động, được thiết kế để giúp người sáng tạo xây dựng trò chơi nhanh hơn. Mặc dù các công cụ này đã có thể viết script, chèn tài sản và sửa đổi môi trường, nhưng việc đo lường hiệu suất thực tế của chúng trong các kịch bản phát triển thực tế vẫn còn khó khăn. OpenGameEval ra đời nhằm giải quyết vấn đề đó bằng cách giới thiệu một framework gốc Roblox Studio để đánh giá các trợ lý AI trong điều kiện thực tế.

Được phát triển bởi Tiantian Zhang, Kartik Ayyar, Mengsha Sun và Lynn Gong, OpenGameEval được định vị là hệ thống đánh giá đầu tiên được xây dựng trực tiếp dựa trên quy trình làm việc của Roblox Studio. Thay vì cô lập các đoạn mã hoặc dựa vào các lời nhắc không trạng thái, nó chạy các mô hình AI bên trong các phiên chỉnh sửa và chơi mô phỏng, gần giống với cách người sáng tạo thực sự làm việc.

Tại sao các điểm chuẩn truyền thống lại không phù hợp với Roblox

Hầu hết các điểm chuẩn AI hiện có tập trung vào các vấn đề mã hóa hẹp với đầu vào và đầu ra được xác định rõ ràng. Việc phát triển Roblox hiếm khi phù hợp với khuôn mẫu đó. Các trò chơi được xây dựng bên trong thế giới 3D bền vững nơi các script tương tác với các cấp bậc đối tượng, mạng nhiều người chơi và ranh giới máy khách-máy chủ. Các thay đổi được thực hiện ở một phần của trải nghiệm thường phụ thuộc vào ngữ cảnh nằm rải rác trên nhiều script và phiên bản.

OpenGameEval được tạo ra để đáp ứng những hạn chế này. Mục tiêu của nó là kiểm tra xem trợ lý AI có thể suy luận qua môi trường Roblox trực tiếp, hiểu logic hiện có và thực hiện các thay đổi có hiệu lực khi trò chơi thực sự chạy hay không. Cách tiếp cận này chuyển việc đánh giá từ tính đúng đắn lý thuyết sang tính hữu dụng thực tế cho người sáng tạo.

Xem xét kỹ hơn về Framework OpenGameEval

Về cốt lõi, OpenGameEval tái tạo môi trường phát triển Roblox Studio một cách có thể tái lập. Mỗi đánh giá mô phỏng cả hành vi thời gian chỉnh sửa và thời gian chơi, đảm bảo rằng vật lý, mạng và tương tác nhiều người chơi hoạt động chính xác như trong một dự án thực tế. Điều này cho phép người đánh giá quan sát cách các thay đổi của trợ lý AI ảnh hưởng đến trải nghiệm khi nó đang chạy, chứ không chỉ liệu mã có biên dịch được hay không.

Framework này cũng bao gồm mô phỏng đầu vào, cho phép kích hoạt các hành động của người chơi như di chuyển, nhấn nút và thay đổi camera trong quá trình kiểm tra. Điều này đặc biệt quan trọng để đánh giá các tính năng chỉ bộc lộ vấn đề thông qua tương tác. Tất cả chức năng này được cung cấp thông qua một API hợp nhất, giúp các nhóm nghiên cứu dễ dàng so sánh các mô hình ngôn ngữ lớn khác nhau trên cùng một bộ tác vụ.

Kiểm tra các kịch bản phát triển thực tế, không chỉ các đoạn mã

Bộ dữ liệu benchmark OpenGameEval hiện bao gồm 47 trường hợp thử nghiệm được chế tạo thủ công. Mỗi trường hợp dựa trên các tác vụ phát triển Roblox phổ biến, bao gồm cơ chế trò chơi, thiết lập môi trường, hoạt ảnh, giao diện người dùng và âm thanh. Các kịch bản này được xây dựng và xem xét bởi các chuyên gia trong lĩnh vực để đảm bảo chúng phản ánh quy trình làm việc thực tế của người sáng tạo.

Không giống như các thử thách mã hóa truyền thống, các bài kiểm tra này là end-to-end. Một trợ lý AI thành công phải xác định vị trí các script liên quan, diễn giải logic hiện có, quyết định nơi đặt mã mới và thực hiện các thay đổi hoạt động trên cả máy khách và máy chủ. Việc chấm điểm được xử lý thông qua các bài kiểm tra đơn vị có thể thực thi và các chỉ số tiêu chuẩn như pass@k, cho phép kết quả có thể được tái lập và so sánh giữa các mô hình.

Ngữ cảnh thay đổi độ khó như thế nào

Một trong những tính năng xác định của OpenGameEval là tập trung vào sự biến đổi ngữ cảnh. Cùng một lời nhắc có thể được đánh giá trên nhiều môi trường có cấu trúc và độ phức tạp khác nhau. Ví dụ, một tác vụ liên quan đến đèn giao thông bốn chiều có thể được kiểm tra trong một không gian trống, một cảnh ngoại ô đông đúc hoặc một thiết lập bao gồm cả tín hiệu giao thông và người đi bộ. Mỗi biến thể buộc trợ lý AI phải điều chỉnh suy luận của mình dựa trên những gì đã có trong trải nghiệm.

Các tác vụ phức tạp hơn, chẳng hạn như triển khai hệ thống tái tạo máu, yêu cầu mô hình theo dõi logic sát thương trên các script, xác định xem các thay đổi có nên được thực hiện trên máy chủ hay máy khách và đảm bảo thời gian và sao chép hoạt động chính xác. Các kịch bản này được thiết kế để tiết lộ xem trợ lý AI có thể duy trì ngữ cảnh qua nhiều bước hay không, thay vì dựa vào việc khớp mẫu bề mặt.

Kết quả ban đầu làm nổi bật những hạn chế hiện tại

Kết quả ban đầu từ OpenGameEval cho thấy sự phân chia rõ ràng về khả năng AI hiện tại. Các mô hình có xu hướng hoạt động tốt trên các tác vụ nguyên tử liên quan đến thao tác trực tiếp trên một phiên bản hoặc thuộc tính duy nhất. Các hành động như điều chỉnh sức mạnh nhảy của người chơi hoặc cấu hình hiệu ứng hạt thường thành công với độ tin cậy cao.

Hiệu suất giảm mạnh khi các tác vụ yêu cầu suy luận ngữ cảnh sâu hơn. Các kịch bản liên quan đến các thay đổi phối hợp trên các script, lọc cẩn thận các đối tượng có liên quan hoặc hiểu hành vi nhiều người chơi tiếp tục cho thấy tỷ lệ thành công thấp. Những kết quả này nhấn mạnh mức độ cải thiện còn lại trước khi trợ lý AI có thể xử lý đáng tin cậy các tác vụ phát triển Roblox phức tạp một cách độc lập.

Dấu hiệu tiến bộ ổn định

Mặc dù có những thách thức này, OpenGameEval đã ghi nhận những dấu hiệu cải thiện khi các mô hình phát triển. Trong một tác vụ liên quan đến việc thay đổi màu sắc của logo Roblox, các mô hình ban đầu đã thất bại vì đối tượng không được đặt tên rõ ràng. Các đánh giá gần đây hơn cho thấy một số mô hình xác định thành công đối tượng chính xác bằng cách kiểm tra các thuộc tính và vị trí của nó trong cây cấp bậc phiên bản, thay vì chỉ dựa vào quy ước đặt tên.

Những cải tiến gia tăng này cho thấy các trợ lý AI đang dần cải thiện khả năng suy luận cấu trúc trong môi trường trò chơi, ngay cả khi sự hiểu biết ngữ cảnh rộng hơn vẫn còn không nhất quán.

OpenGameEval có ý nghĩa gì đối với người sáng tạo và nhà nghiên cứu

OpenGameEval được thiết kế để phục vụ cả người sáng tạo Roblox và cộng đồng nghiên cứu AI rộng lớn hơn. Bảng xếp hạng công khai cung cấp khả năng hiển thị về hiệu suất của các mô hình khác nhau trên các danh mục như tạo mã và sử dụng công cụ. Đối với các nhà nghiên cứu, framework cung cấp một cách tiêu chuẩn hóa để chạy các đánh giá có thể tái lập trong môi trường engine trò chơi thực tế.

Trong tương lai, nhóm phát triển OpenGameEval có kế hoạch mở rộng bộ dữ liệu, tinh chỉnh các công cụ đánh giá và kết hợp phản hồi từ cộng đồng người sáng tạo. Mục tiêu dài hạn là thiết lập một điểm tham chiếu chung để đo lường sự tiến bộ trong AI có khả năng hành động cho phát triển trò chơi, bao gồm cả các ứng dụng trong tương lai gắn liền với nền kinh tế sáng tạo theo phong cách web3.

Xem Thẻ quà tặng Roblox trên Amazon tại đây.

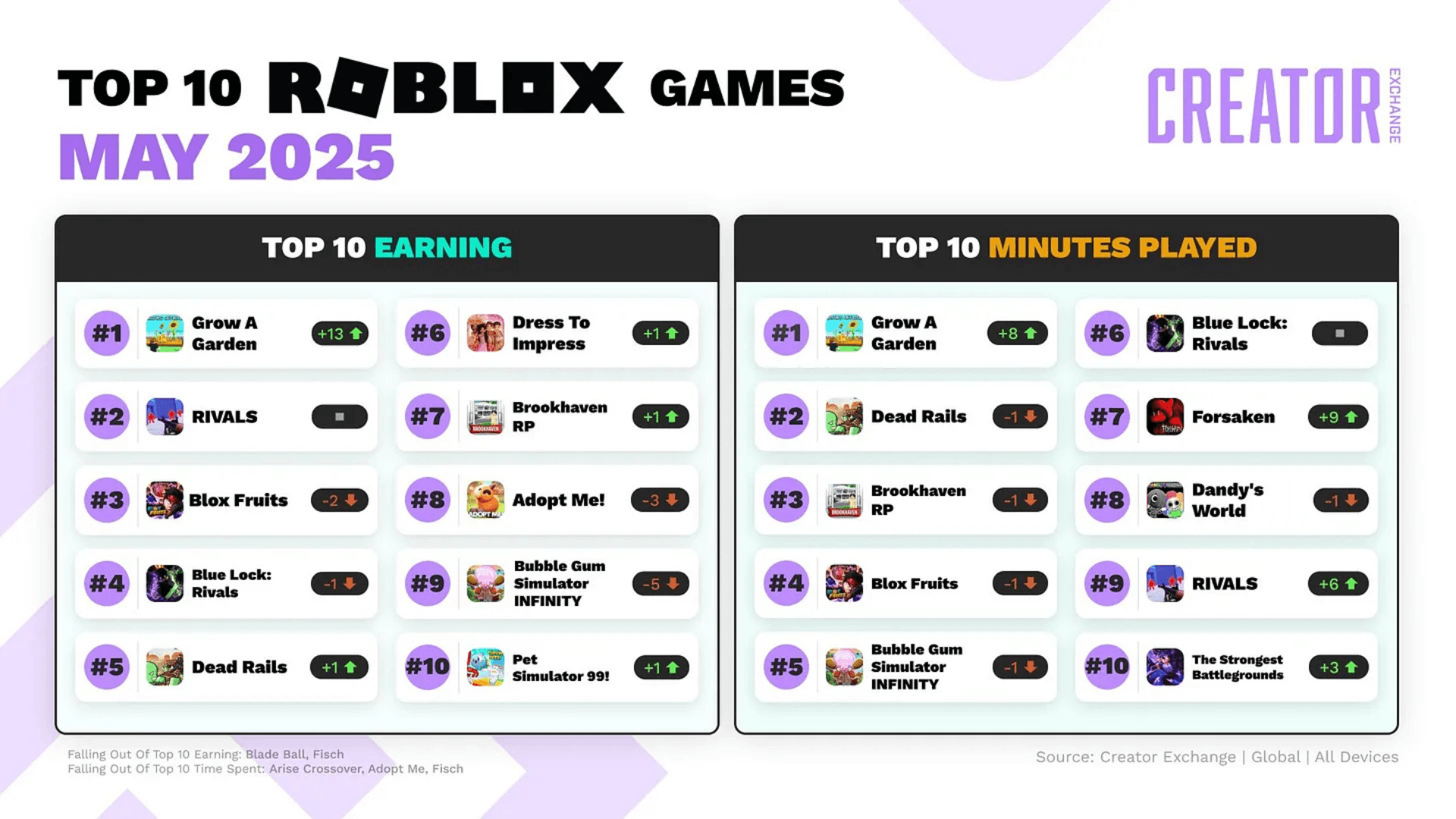

Tìm hiểu về các trải nghiệm Roblox phổ biến khác tại đây:

Câu hỏi thường gặp (FAQs)

OpenGameEval là gì?

OpenGameEval là một framework đánh giá và benchmark mã nguồn mở được thiết kế để kiểm tra các trợ lý AI trực tiếp bên trong Roblox Studio. Nó đo lường mức độ hiệu quả của các mô hình trong các tác vụ phát triển thực tế thay vì các vấn đề mã hóa cô lập.

OpenGameEval khác với các điểm chuẩn AI khác như thế nào?

Không giống như các điểm chuẩn truyền thống, OpenGameEval chạy đánh giá trong môi trường Roblox Studio mô phỏng. Điều này cho phép nó kiểm tra suy luận ngữ cảnh, hành vi nhiều người chơi và tương tác có trạng thái phổ biến trong phát triển trò chơi.

OpenGameEval bao gồm những loại tác vụ nào?

Benchmark bao gồm các tác vụ liên quan đến cơ chế trò chơi, scripting, xây dựng môi trường, hoạt ảnh, giao diện người dùng và âm thanh. Nhiều tác vụ yêu cầu suy luận đa bước trên nhiều script và đối tượng.

Ai có thể sử dụng OpenGameEval?

Framework này là mã nguồn mở và dành cho các nhà nghiên cứu AI, nhà phát triển công cụ và các nhóm xây dựng hoặc đánh giá trợ lý AI cho Roblox Studio.

Tại sao OpenGameEval lại quan trọng đối với người sáng tạo Roblox?

Bằng cách cung cấp dữ liệu hiệu suất minh bạch và đánh giá thực tế, OpenGameEval giúp người sáng tạo hiểu được điểm mạnh và hạn chế của trợ lý AI và theo dõi cách các công cụ này cải thiện theo thời gian.